Зачин примеры 5 класс: Зачин сказки, примеры 🤓 [Есть ответ]

Признаки сказки в произведении Пушкина о мертвой царевне

1. Зачин

В произведении присутствует зачин:

«Царь с царицею простился,

В путь-дорогу снарядился».

2. Волшебные предметы, сверхъестественные силы

В сказке происходят различные чудеса:

- волшебное зеркало

- общение Елисея с солнцем, месяцем и ветром

- воскрешение царевны

3. Троекратные повторы

Королевич Елисей трижды обращается к природным объектам, с просьбой о помощи: к солнцу, к месяцу и к ветру.

4. Борьба добра и зла

На протяжении всей сказки происходит борьба между добрыми и злыми образами. Добро — молодая царица, зло — царевна мачеха.

5. Положительные и отрицательные герои

В волшебных сказках обязательно присутствуют положительные и отрицательные герои. В нашем случае отрицательный герой — злая мачеха. К положительным героям можно отнести молодую царевну, ее жениха Елисея, и богатырей.

5. Победа добра

В сказках традиционно побеждает добро. И это произведение не стало исключением: царевна ожила, а злая мачеха умерла от злости.

6. Концовка

В сказке о мёртвой царевне история заканчивается свадьбой и пиршеством:

«И никто с начала мира

Не видал такого пира;»

7. Присказка

Присказка следующая:

«Я там был, мед, пиво пил,

Да усы лишь обмочил.»

8. Нескрываемая вымышленность сюжета

Особенностью сказки является то, что ее сюжет является чистой выдумкой и далек от реальной истории. Можно сказать, что это относится к этому произведению.

9. Преодоление потери

Часто в начале сказок происходит какая-то потеря или разлука, которая преодолевается на протяжении всего повествования.

В нашем случае потерялась царевна, и ее искал королевич Елисей.

10. Два поколения

Отличительная особенность сказок — наличие двух поколений. В этой сказке есть царь и его дочь.

В этой сказке есть царь и его дочь.

План и структура итогового сочинения 2021-2022 по литературе в 11 классе

]]>- 14.09.2021

Обновлено 16.09.2021

Разбираем детально план и структуру написания итогового сочинения в 11 классе по литературе. Следование этому плану поможет вам написать сочинение максимально правильно и получить все баллы за его проверку.

АКТУАЛЬНО ДЛЯ 2022 ГОДА

Коротко о композиции и структуре итогового сочинения

]]>

Общая структура итогового сочинения

I. Вступление (60-70 слов). Отразите идею будущего сочинения и основные тезисы.

II. Основная часть (включающая несколько подпунктов) — 200-250 слов.

Тeзис 1 (20-30 слов)

- Дoкaзaтeльствa, пpимepы (oдин или нeскoлькo)

- Микpoвывoд (oбoбщeниe нaписaннoгo)

- Лoгичeский пepeхoд к нoвoй мысли

Тeзис 2

- Дoкaзaтeльствa, пpимepы

- Микpoвывoд

III. Заключение (60-70 слов)

Заключение (60-70 слов)

А теперь рассмотрим подробный план и структуру итогового сочинения

I. Вступление раскрывает основную мысль, вводит в круг рассматриваемых проблем.

Вступление состоит из 3 элементов:

- объяснение ключевых слов темы или цитаты;

- общие рассуждения о значимости предложенных для объяснения понятий в жизни

человека; - ответ-тезис на главный вопрос темы.

Все эти элементы последовательно располагаются друг за другом.

Темы, предложенные для итогового сочинения, можно разделить на 3 типа:

- тема-вопрос — задаём главный вопрос темы, на который будем отвечать в основной части. Будьте осторожны в формулировке вопроса: не уходите от темы. В этом случае можно использовать клише: «можно ли утверждать, что… », «почему можно говорить, что это высказывание справедливо», «действительно ли.

.. » и т. д.,

.. » и т. д., - тема-утверждение (в т.ч. цитата) — требуется обосновать уже имеющееся утверждение,

- тема — назывное предложение (ключевые слова). Нужно сформулировать свое суждение о каждом из них, дать ответы на поставленные вопросы.

II. Основная часть раскрывает идею сочинения и связанные с ней вопросы, представляет систему доказательств выдвинутых положений.

Основная часть = Тезис + Аргумент(ы)

Тезис — это основная мысль сочинения, которую нужно аргументировано доказывать. Формулировка тезиса зависит от темы сочинения.

Помни!

- По oбъeму oснoвнaя чaсть дoлжнa быть бoльшe, чeм вступлeниe и зaключeниe, вмeстe взятыe.

- Тeзис, пoдкpeплeнный apгумeнтoм, мoжeт быть всeгo oдин.

- Оптимaльнoe кoличeствo литературных аргументов – 2.

- Кaждoму тeзису – свoй apгумeнт!

- Связка – это переход от одной мысли к другой. Нужно плавно переходить от тезиса к аргументации.

Аргумент нужно:

- привести из литературных источников.

- выделить в отдельный абзац.

- в конце каждого аргумента написать микровывод.

- к одному тезису привести один литературный аргумент, но лучше, чтобы аргументов было два.

- если тезисов несколько, то к каждому из них приводится свой аргумент!

Аргумент состоит из 3 элементов:

- Обращение к литературному произведению – называем автора и произведение, его жанр (если знаем; если не знаем, то так и пишем — произведение», чтобы избежать фактических ошибок).

- Его интерпретацию – здесь мы обращаемся к сюжету произведения или конкретному эпизоду, характеризуем героя(-ев). Желательно несколько раз упомянуть автора, используя речевые клише типа «автор повествует», «автор описывает», «писатель рассуждает», «поэт показывает», «автор считает» и т. п. Почему нельзя просто написать: «герой пошёл туда-то, сделал то-то» ? А потому что это будет уже не анализ, а простой пересказ.

- Микровывод (он завершает только одну из микротем, а не всё сочинение в целом; нужен для логичности и связности текста): в этой части мы, как правило, формулируем основную мысль всего упомянутого произведения или авторскую позицию по конкретной проблеме. Используем клише типа «писатель приходит к выводу… » и т. п.

III. Заключение подводит итоги, содержит конечные выводы и оценки.

4 способа закончить сочинение:

- Вывод. Принято завершать сочинение выводом из всего вышесказанного, но нельзя повторять те микровыводы, которые уже делались в сочинении после аргументов.

- Заключение-призыв. Не используй пафосные лозунги «Берегите нашу Землю!» . Лучше не использовать глаголы 2 -го лица: «берегите», «уважайте», «помните» . Ограничьтесь формами «нужно», «важно», «давайте» и т. д. .

- Заключение — выражение надежды, позволяет избежать дублирования мысли, этических и логических ошибок.

Выражать надежду нужно на что-нибудь позитивное.

Выражать надежду нужно на что-нибудь позитивное. - Цитата, подходящая по смыслу и высказана уместно. Рекомендуем заранее подготовить цитаты по всем тематическим направлениям, чтобы соответствовало главной мысли сочинения.

Помни: смысл цитаты обязательно должен соответствовать главной мысли сочинения.

Что вас ждёт в документе ниже:

- какое должно быть вступление,

- из чего состоит основная часть сочинения,

- как сформулировать тезисы и аргументы,

- как правильно сделать связку между абзацами,

- как правильно написать заключение в итоговом сочинении,

- как добиться уникальности сочинения.

Обращаем ваше внимание, что у ВУЗов (при поступлении) очень часто используются собственные критерии проверки, имейте это в виду (и они существенно отличаются от проверки школьного уровня).

Смотреть в PDF:

Или прямо сейчас: cкачать в pdf файле.

Представленная здесь структура сочинения актуальная для любого года и не зависит от темы и направления итогового сочинения. Поэтому вы можете смело использовать этот материал при подготовке в любом году.

Структуру сочинения условно можно разделить на два вида:

- Композиционная.

- Логическая.

Рассмотрим подробнее каждую из них.

Композиционная структура

- Вступление

- Основная часть

- Заключение

Логическая структура

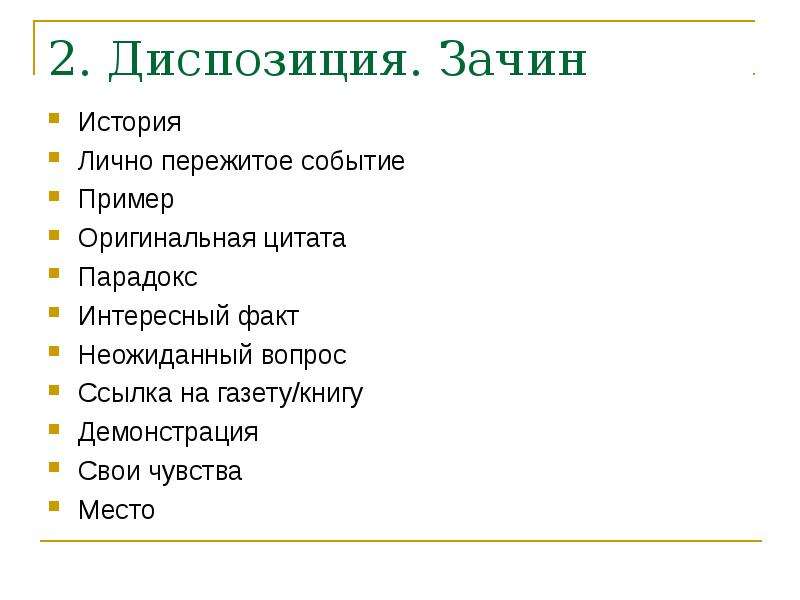

Зачин. Подготовка к восприятию основных мыслей работы

Тезис 1

Доказательства, примеры

Микровывод

Тезис 2

Доказательства, примеры

Микровывод

Тезис 3

Доказательства, примеры

Микровывод

(…)

Вывод. Обобщение по всей теме

Смотреть в PDF:

Или прямо сейчас: cкачать в pdf файле.

Добавить комментарий

Комментарии без регистрации. Несодержательные сообщения удаляются.

Краткий словарь терминов. Литература 5 класс. Учебник-хрестоматия для школ с углубленным изучением литературы. Часть 1

Краткий словарь терминов

Аллего?рия – один из художественных приемов, иносказание, изображение какой-нибудь отвлеченной идеи в конкретном, отчетливо представляемом образе.

Анималисти?ческое произведе?ние – литературное произведение, в котором правдиво показаны повадки и характерные черты каких-либо животных и где нередко животные оказываются главными героями.

Анони?мное произведе?ние – литературное произведение, чье авторство по каким-либо причинам не установлено.

Балла?да (литерату?рная) – лиро-эпический жанр, в котором на основе сюжетного повествования об исторических событиях, личных драмах или фантастических явлениях дается лирическая эмоциональная оценка персонажей. Как правило, включает в себя пейзажный зачин, пейзажную концовку и строится на введении открытого (явного) или скрытого (монолог, обращенный к молчащему собеседнику, введение обращений) диалога, подразделяется на исторические, семейные, фантастические (страшные) и пр.

Как правило, включает в себя пейзажный зачин, пейзажную концовку и строится на введении открытого (явного) или скрытого (монолог, обращенный к молчащему собеседнику, введение обращений) диалога, подразделяется на исторические, семейные, фантастические (страшные) и пр.

Балла?да (фолькло?рная)

Ба?сня – эпический жанр, в котором художественный мир, где живут и действуют животные и предметы, создан с помощью художественного приема аллегории, носящего нравоучительный и воспитательный характер. Басня может быть стихотворной и прозаической.

Были?на – жанр русского фольклора, эпическая песнь героического содержания, повествующая о подвигах русских богатырей и отражающая жизнь средневековой Руси.

Герои?ческое – изображение действий персонажа, требующих предельного напряжения его сил и готовности к самопожертвованию во имя поставленной цели.

Дета?ль (худо?жественная) – описание какого-то предмета или явления внешнего мира, части портрета или пейзажа с целью эмоциональной оценки не только описываемой части, но и всего целого, к которому она (часть) относится.

Де?тский фолькло?р – произведения устного народного творчества, созданные детьми или для детей (например, считалки).

Диало?г – способ повествования в литературном произведении, когда приводится прямая речь персонажей, обменивающихся репликами, содержащими оценку и сущность того, о чем повествуется.

Дра?ма – один из литературных родов, художественный мир которого предполагает сценическое воплощение в виде спектакля.

Драматурги?я – обобщенное наименование всех литературных произведений, предназначенных для сценического воплощения в театре.

Ду?ма – жанр лиро-эпической поэзии, близкий к балладе.

Жанр – сходные черты создания художественного мира в ряде произведений, определяемые особенностями художественной условности данных произведений.

Жизнеподо?бие – один из видов художественной условности, смысл которого состоит в придании характерам и обстоятельствам произведения сходства с характерами и обстоятельствами реальной действительности.

Зага?дка – фольклорный жанр, в котором предлагается поэтический вопрос для нахождения правильного ответа по содержащейся в самом вопросе информации.

За?говор – фольклорный жанр, имеющий магическое значение и призванный с помощью определенных сочетаний слов оказать определенное воздействие на материальный мир (унять боль, уберечь от порчи и т. д.).

Заклина?ние – фольклорный жанр, магическая формула, призванная воздействовать на природу или человека; обычно сопровождается ритуальными (магическими) действиями.

Закли?чки – жанр детского фольклора, наивное поэтическое обращение к силам природы.

Идеа?л – в литературе авторское представление о том, каким должен быть человек и мир, его окружающий, определяющее отношение и оценка автором изображаемых событий и персонажей, не следует путать понятия «идеал» и «идеальный герой» как персонаж, лишь приближающийся к воплощению идеала.

Иро?ния – скрытая насмешка.

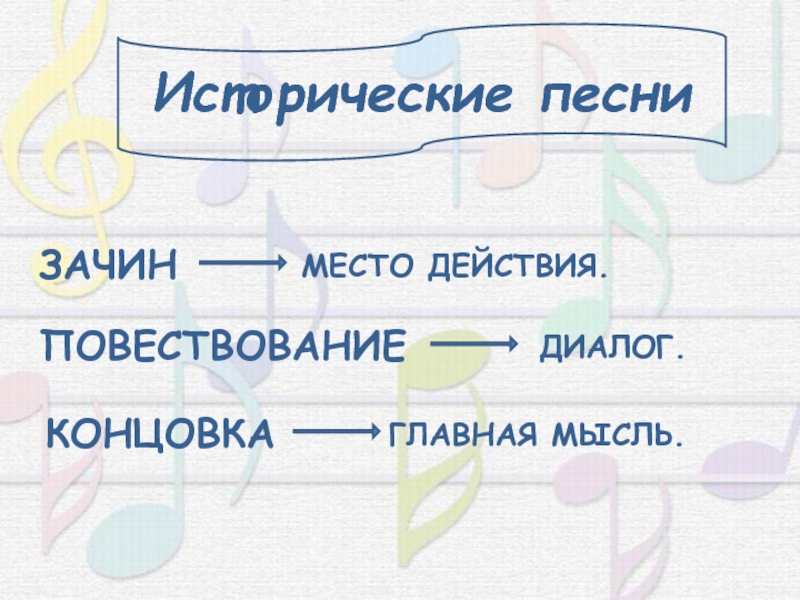

Истори?ческие пе?сни – фольклорный жанр, близкий народной балладе, в котором содержится лирическое описание и оценка какого-либо исторического события или исторической личности.

Конфли?ктная ситуа?ция – создание с помощью художественных средств такого положения в художественном мире произведения, которое требует от персонажей активных действий, ставит их перед необходимостью вступить в борьбу с противостоящими силами.

Леге?нда – фольклорный и литературный жанр, в котором представлено мифологизированное повествование о реальном важном историческом событии или о деяниях исторической личности; характерной чертой жанра является идеализация событий и героев.

Ли?рика – один из литературных родов, в котором художественный мир произведения отражает внутренние переживания лирического героя, эмоциональное восприятие действительности.

Лири?ческая оце?нка – эмоциональное восприятие описываемого, выраженное в произведении художественными средствами.

Ли?ро-э?пика – один из литературных родов, художественный мир произведений которого читатель наблюдает и оценивает со стороны (эпическое начало), но одновременно события и персонажи получают эмоциональную оценку повествователя (лирическое начало).

Литерату?ра – один из видов искусства и форма общественного сознания; словесными средствами создавая художественную реальность, она выполняет эстетическую, познавательную и воспитательную функции, вовлекая читателя в зону мощного эмоционального воздействия и заставляя его принять точку зрения автора.

Ма?гия – совокупность действий, обрядов, ритуалов и словесных формул, воздействующих на материальный мир с целью его изменения, а также установления связей между реальным и ирреальным мирами.

Мистифика?ция – художественный прием, заключающийся в том, что автор приписывает свое произведение другому, известному или вымышленному автору; часто сочетается со стилизацией.

Миф – объяснение сложных явлений природы, происхождения мира и человека с помощью художественной фантазии, восполняющей недостаточность научных знаний.

Моноло?г – развернутое высказывание одного персонажа или повествователя.

Нове?лла – литературный эпический жанр, в основе которого лежит художественное описание одного завершенного события и его авторская оценка.

Обря?довая пе?сня – жанр фольклора, песня, являющаяся частью магического ритуала и призванная способствовать магическому обряду (свадебные песни, похоронные песни, плачи и т. п.).

О?черк (литерату?рный) – эпический жанр, художественное повествование о реальных людях или событиях.

Пейза?ж – описание природы в литературном произведении; может использоваться для мотивировки действий персонажей, передавать их душевное состояние и создавать эмоциональный настрой произведений (эпизода).

Персона?ж – обобщенное обозначение любого действующего лица литературного произведения.

Плач – фольклорный жанр, художественное воплощение скорби по утраченному, может быть в стихотворной или прозаической форме, сохраняет в себе элементы магического действия.

Повествова?тель – условный образ, от лица которого ведется рассказ в произведении.

Погово?рка – образное, крылатое одночастное выражение, становящееся устойчивым оборотом речи.

Посло?вица – краткое, ритмически организованное изречение, содержащее суждение из области философии, морали и т. д.

Поэ?тика – 1) система художественных средств и приемов, используемых писателем для создания художественного мира отдельного произведения и в его творчестве в целом; 2) учение о принципах и законах создания литературного произведения («Поэтика» Аристотеля, «поэтика классицизма» и т. д.).

Причита?ния – фольклорный жанр, формулы выражения скорби при каких-либо печальных событиях (расставании, похоронах и т. п.).

п.).

Про?за – немелодический (без явно выраженной напевности) способ художественного повествования в литературе.

Пье?са – термин, обозначающий любое драматическое произведение (предназначенное для постановки на сцене театра) без указания на жанр, к которому это произведение относится.

Расска?з – термин, синонимичный термину «новелла». При использовании обоих терминов под новеллой подразумевается короткий рассказ с динамичным сюжетом и неожиданной концовкой.

Ритм – в фольклорном и литературном произведениях один из отличительных признаков поэтической речи: подчиненная художественным задачам расстановка логических ударений (акцентов) и смена интонаций повествования; различаются мелодический ритм (стихи) и немелодический (проза).

Ро?ды литерату?ры – четыре основные группы, на которые подразделяются все произведения словесного творчества по принципам восприятия читателем (слушателем) художественного мира произведения (см. эпос, лирика, драма, лиро-эпика).

эпос, лирика, драма, лиро-эпика).

Сказ – эпический жанр, опирающийся на народные предания и легенды, а также название особого повествования, имитирующего разговорную речь.

Ска?зка (литерату?рная) – эпический жанр, формирующий на основе фантастической условности мифологический художественный мир для создания необычных ситуаций, в которых вынужден действовать герой. Подразделяются на философские, дидактические (воспитательные) и сатирические.

Ска?зка (фолькло?рная) – фольклорный жанр, стремящийся на основе фантастической условности дать наиболее полное, обобщенное изображение мира, в котором живет человек.

Спектакль – воплощение на сцене театра в драматической игре актеров художественного содержания пьесы.

Стилиза?ция – литературный прием, состоящий в том, что автор, создавая свое произведение, подражает стилю и художественным средствам какого-либо другого известного произведения или автора.

Стихи? – художественная речь, создающая языковыми средствами мелодичность (напевность) повествовательного ритма.

Сцена?рий – переработка литературного произведения с целью его сценического воплощения.

Те?ма – основной предмет повествования, то главное, о чем сообщается в произведении.

Трудовы?е пе?сни – фольклорный жанр; песни, сопровождающие трудовой процесс и своим ритмом и эмоциональными установками способствующие его облегчению.

У?стное наро?дное поэти?ческое тво?рчество – совокупность произведений, созданных анонимными сказителями и бытующих в народной среде в устной передаче, во время которой происходит дальнейшая обработка и варьирование первоначального материала.

Фанта?стика – один из видов художественной условности: построение художественного произведения или его части на основе вымысла.

Фолькло?р – то же самое, что и устное народное поэтическое творчество, этот термин также применяется и к другим видам искусства.

Худо?жественная усло?вность – отличительная черта любого искусства, противопоставляющая реально существующему миру мир, созданный воображением художника: может быть явной (фантастика) и скрытой, имитирующей реальную действительность (жизнеподобие).

Худо?жественный вы?мысел – описание, возникающее в результате творчества и создающее на основе одного (или нескольких) видов условности художественный мир произведения.

Худо?жественный мир – вымышленная реальность, существующая в пределах конкретного художественного произведения по законам, заданным творческой фантазией автора.

Худо?жественные сре?дства – использование возможностей языка для создания художественных образов, построения художественного мира произведения и эмоционального воздействия на читателя.

Худо?жественный о?браз – образ, возникающий в сознании читателя (слушателя) фольклорного или литературного произведения в результате эмоционального отклика на эстетические чувства автора, запечатленные в произведении художественными средствами.

Часту?шки – жанр русского фольклора, содержательно законченная стихотворная строфа юмористического или сатирического содержания: часто создаются на основе импровизации.

Э?пос – один из литературных родов, в котором читатель воспринимает художественное произведение как бы со стороны, имея возможность составлять собственное суждение об описываемых событиях и персонажах.

Ю?мор – веселая добродушная насмешка над кем-либо или чем-либо.

Данный текст является ознакомительным фрагментом.

Продолжение на ЛитРесЧто такое особый сказочный зачин. Значение слова зачин в словаре литературоведческих терминов

Что такое зачин в сказке знают, пожалуй, единицы, а ведь этот раздел зачастую является одним из наиболее важных факторов в построении всей истории сказочного повествования. Зачином сказки является ее начало, которое рассказывает о прошлой жизни главных героев, а также о происходящей в мире истории, затрагивающей героев сказки.

Зачином сказки является ее начало, которое рассказывает о прошлой жизни главных героев, а также о происходящей в мире истории, затрагивающей героев сказки.

Зачину свойственно описывать и образы городов, предметов и других вещей, которые начинают историю. Именно в этой части рассказа, автор доносит одну из главных идей в сказке и пытается заинтересовать читателя, предысторией своего сказочного мира, заложив образы для последующего повествования. Дает данная часть и представление о мире, воплощая текст в голове читателя, заставив почувствовать себя в волшебном мире. Зачастую в русских сказках, зачин начинается с фразы «Жили-были…».

В общем, можно с точностью сказать, что зачин является важной частью сказки, сопоставив с концом. Ведь обе этих части несут в себе моральные ценности и показывают сформировавшиеся характеры главных героев. Еще можно отметить, тот факт, что большинство зачинов народных сказок, отличаются свои разнообразием и структурой, не показывая однотипности из сказки в сказку, а делая ее уникальной и интересной.

С раннего детства сказки радуют человека своими удивительными историями, о непобедимых рыцарях и благородных принцессах, готовых идти на любые риски, чтобы найти свое счастье и исполнить собственные мечты. Они приносят людям добрые чувства и надежду в их сердца, а детям помогают сформировать мнение об окружающем их мире. Сами же сказки появились в глубокой древности и несли в себе свод законов о природе, а также поучение для людей.

Русские сказки же появились из перехода рассказов в поколение из поколения, таким образом, данные истории несли в себе поучительный характер, давая людям ценные советы. Никто не знает, где же возникла первая сказка, ведь данные истории упоминаются еще в письменах древних государств. Наши народные сказки делятся на три типа: о животных, волшебные и бытовые. Распространенными сказками считают рассказы о животных, а самыми занимательными люди всегда считали сказки связанные с волшебством. Во всех историях сказок, главным образом выделяется основа борьбы добра со злом и их извечное противостояние. Герои сказок, как добрые, так и злые, являются лишь символами добра и зла, вынужденные бороться из-за разногласий или же поступков друг друга. В некоторых сказках обычно трудно различить злого персонажа от доброго, такие рассказы зачастую написаны писателями, которые пытались внести что-то свое в данную историю. В народных сказках же всегда есть выделенный главный злодей, который противодействует добрым персонажам.

Герои сказок, как добрые, так и злые, являются лишь символами добра и зла, вынужденные бороться из-за разногласий или же поступков друг друга. В некоторых сказках обычно трудно различить злого персонажа от доброго, такие рассказы зачастую написаны писателями, которые пытались внести что-то свое в данную историю. В народных сказках же всегда есть выделенный главный злодей, который противодействует добрым персонажам.

- Война Алой и Белой розы краткое содержание Войны роз

Династией Ланкастеров в Англии правила француженка – Маргарита, это вызвало недовольство династии Йорков. Бароны северной Англии и Ирландии приняли сторону Ланкастеров. Тогда как Йоркам помогали феодалы, купцы и горожане.

- Какие животные делают запасы на зиму?

Запасаются на зиму несколько животных такие как белки, норки, кроты, медведи, бурундуки, и другие грызуны, насекомые и даже птицы

С ними люди знакомятся с самого детства. Основная функция сказок – воспитательная, ведь они учат добру, бескорыстности, альтруизму.

История русского фольклора насчитывает большое количество сказок. Многие из них существуют в нескольких вариантах.

Сказка и ее жанровые разновидности

Сказки могут быть разными. Основная классификация делит их следующим образом:

1. Сказка о животных. Главными персонажами и действующими лицами являются животные. В русской литературе каждое животное является аллегорией какого-либо Например, лиса олицетворяет хитрость, заяц – трусливость и т. д.

2. Волшебная сказка. Имеет достаточно сложную композицию. Началом такой сказки, как правило, является зачин. В сказке это непременное условие, которое выражает мораль, основную мысль и идею.

3. Новеллистическая сказка. Героем является человек, который совершает удивительные вещи. Только если в волшебных помогают волшебные предметы или необычные животные, то в новеллистических персонаж пользуется только своим умом.

4.Бытовая сказка. Она рассказывает о жизни человека в обычном мире без волшебства.

Каждая сказка начинается по-своему. Большого внимания заслуживают зачины русских сказок, однако, прежде чем их рассматривать, необходимо познакомиться со структурными элементами традиционной сказки.

Большого внимания заслуживают зачины русских сказок, однако, прежде чем их рассматривать, необходимо познакомиться со структурными элементами традиционной сказки.

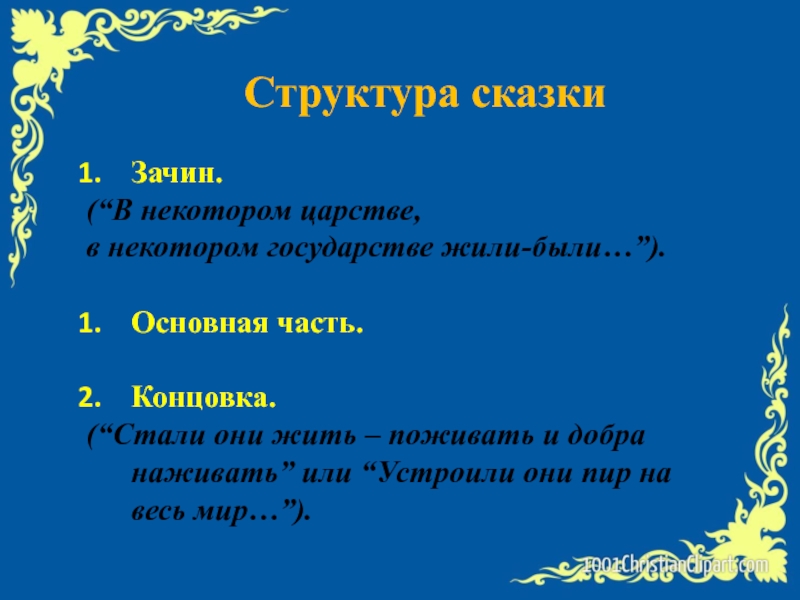

Структура сказки

Сказка начинается с зачина. После него начинаются основные события. Герой попадает в необыкновенную ситуацию. Затем в сказке происходят перипетии – действия. Герои пересекаются друг с другом. Наступает самый ответственный момент – кульминация. После кульминации идет спад событий, а впоследствии – развязка.

Такова структура обыкновенной истории.

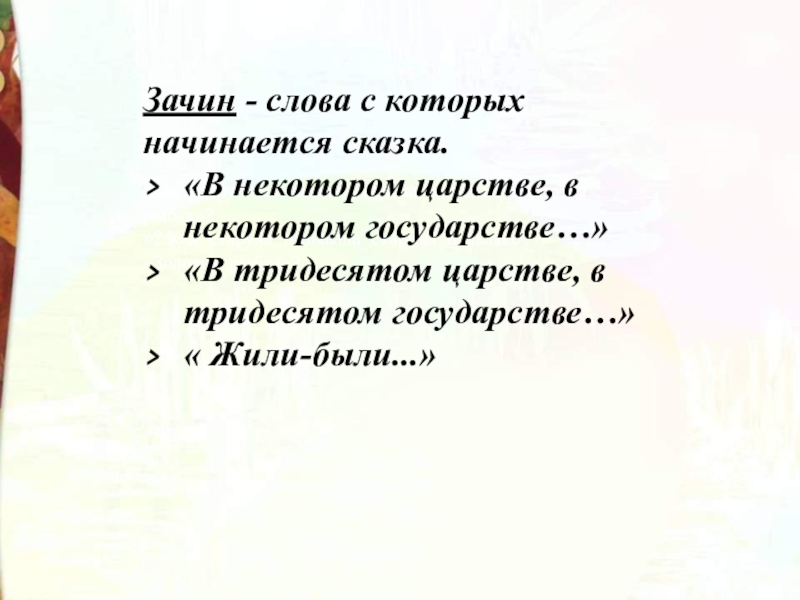

Немного о зачине

Зачин в сказке – это начало сказки. Он может быть коротким (состоять из одного предложения), а может быть длиной в целый абзац. Зачин вводит читателя в сказочную историю. Он дает первоначальные сведения о персонажах, например “жил да был крестьянин”.

Зачин в сказке – это небольшое отступление, которое задает тон повествования. Основные цели зачина:

1. Привлечь внимание слушателей. Зачины русских народных сказок могут представлять собой пословицу или поговорку. Читателю или слушателю становится интересно, как данная сказка связана с указанным в зачине предложением.

Читателю или слушателю становится интересно, как данная сказка связана с указанным в зачине предложением.

2. Задать тон повествованию. Зачин нередко определяет жанр произведения. Подобным приемом пользовались и русские классики, например, Салтыков-Щедрин сказку “Премудрый пескарь” начинает со слов: “Жил-был пескарь”.

Таким образом, зачин – это основная структурная единица сказки, которая настраивает читателя на прочтение произведения и определяет жанровое своеобразие.

Зачины в русских сказках

Сложно найти человека, который не смог бы вспомнить хотя бы один зачин. В сказке это основная часть, поэтому без него трудно обойтись.

Большинство сказок начинаются со слов “жили-были…”, “жил-был…”. Особенностями такого зачина является неоднократный повтор однокоренных слов.

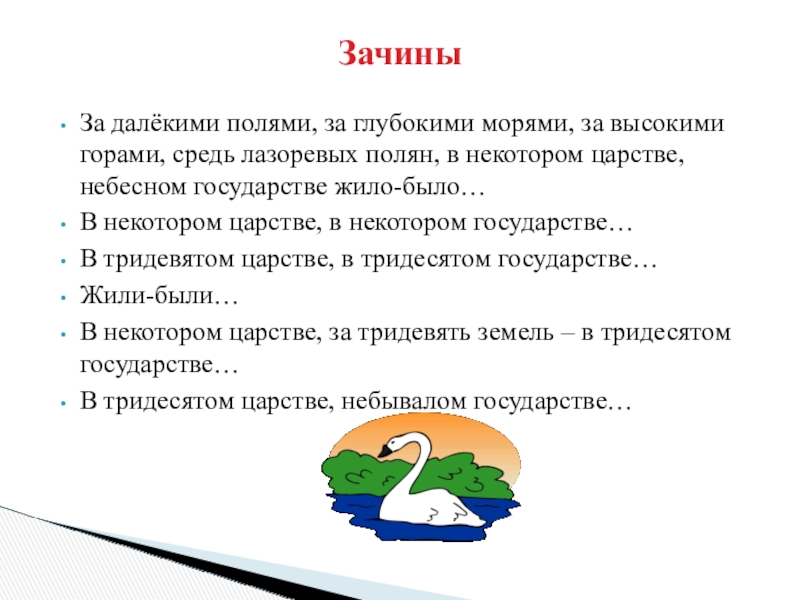

Не менее известны и зачины русских народных сказок, начинающиеся со слов “в некотором царстве, в некотором государстве…”. Похожий зачин – “в тридевятом царстве, в тридесятом государстве. ..”. Такие вступления свойственны волшебным сказкам.

..”. Такие вступления свойственны волшебным сказкам.

Иногда сказки открываются поговорками со словом “зачин”, например “зачин дело красит” или “каждое дело имеет начало, каждый сказ – зачин”. После такого вступления непосредственно начинается сама история.

Таким образом, мы можем сделать следующий вывод: зачин – это особенное начало сказки, свойственное произведениям русского фольклора. Он может выступать либо как сказки, либо нести в себе определенную смысловую нагрузку.

Тема: Композиционные части сказки: присказка, зачин, концовка.

Цель: Систематизация знаний по теории литературы (композиционные производные)

Задачи для учащихся:

1.Знать композиционные части сказки.

2.Научиться находить их в тексте.

3.Составлять сказку по композиционным частям.

Предполагаемые результаты:

1.Знают, из каких композиционных частей состоит сказка и их определение.

2.Умеют находить композиционные части в тексте.

3.Составляют свою сказку, используя все её композиционные части.

Ход урока.

I . Мотивационный этап.

1.Психологический настрой на урок.

Показ мультфильма «Командное взаимодействие» на интерактивной доске.

Вопросы после просмотра:

2.Формирование групп.

Учитель назначает командиров групп:

Выберите каждый для себя одного ученика – спикера, спикер выберет секретаря, секретарь – таймспикера.

Покажите смайликом, как вы себя чувствуете в данной группе.

Повторение правил работы в группах.

4.Целеполагание.

Учитель.

Прочитайте текст на карточках и выполните пометки. (Метод «Инсерт»)

Учащиеся читают текст карточки и делают пометки:

«!» – знаю, согласен;

«-»-не согласен;

«+»-интересно и неожиданно;

«?»- не знаю, хочу узнать.

После заполнения таблицы задаётся вопрос классу:

Что заинтересовало вас при работе с таблицей? (Отвечают и останавливаются на пометке «не знаю, хочу узнать»

Я хочу вам помочь в получении новых знаний. Определите тему сегодняшнего урока.

Определите тему сегодняшнего урока.

Что такое присказка, зачин, концовка в сказке.

С какой целью вы хотите это узнать?

Чтобы находить присказку, зачин, концовку в сказках. Чтобы самим правильно сочинить интересную красивую сказку.

Запишем тему урока в тетрадь.

II . Операционный этап.

1.Определение композиционных частей. Работа в парах. Метод «Прогнозирование».

Учитель: У каждой пары есть карточка. Рассмотрите и попробуйте определить с помощью стрелок присказку, зачин, концовку. (Используются карточки двух вариантов)

1 вариант

Имя_________1)Ой ду-ду! На дубу

Грянул ворон во трубу.

И пошли чудеса:

Засинели небеса,

Вышли в море паруса,

Встали тёмные леса.

2) Жили себе дед да баба. Дед и говорит бабе:

Ты, баба, пеки пироги, а я запрягу сани, поеду за рыбой….

3) Вот и стали они жить –поживать да добра наживать.

КОНЦОВКА

ПРИСКАЗКА

ЗАЧИН

2 вариант.

Имя_ ________1) А в лесной избушке

Затопилась печь –

Пироги с морошкой

Начал зайка печь.

Пирогов покушай,

Сказочку послушай.

2) В старые годы у одного царя было три сына. Вот, когда сыновья стали на возрасте, царь собрал их и говорит:

Сыновья мои любезные, покуда я ещё не стар, мне охота бы вас женить, посмотреть на ваших деточек, на моих внучат…

3) И я там был. Мёд-пиво пил, по усам текло, а в рот не попало.

КОНЦОВКА

ПРИСКАЗКА

ЗАЧИН

2.Проверка. Взаимопроверка пар по ключу в учебнике (стр.39-40. Литературное чтение, 2 класс)

Кто определил правильно? У кого не получилось, не расстраивайтесь, сейчас вы прочитаете точное определение понятий и сможете правильно находить в сказках присказку, зачин и концовку. (Самостоятельное чтение правил в учебнике Стр.39-40. Работа в группах)

Чем сказка отличается от рассказа?

В рассказе нет присказки, зачина и концовки.

По каким признакам мы отличаем сказку?

Слова «жили-были», «однажды». Положительные и отрицательные герои. Добро и зло. Добро побеждает.

3.Определение последовательности композиционных частей сказки. (Работа в группах)

Расположите карточки с названиями композиционных частей в том порядке, в котором, вы считаете, располагаются композиционные части в сказке.

Карточки:

Присказка

зачин

концовка

4.Проверка методом «Делегирование». Делегаты от групп заходят в другие группы и смотрят выполненную работу. Свои мысли, оценку и предложения оставляют на стикере. В каждой группе остаётся спикер, который представляет работу своей группы.

Присказка

зачин

концовка

5. Физминутка «Весёлая зарядка» на интерактивной доске.

6.Закрепление изученного материала.

Карточки с разноуровневыми заданиями. (Обосновать свой выбор)

1 уровень.

Задание: Прочитайте сказку и разделите её на композиционные части.

Будет сказка занимательна. Слушайте её внимательно. Кто уши широко раскроет – много всякой всячины усвоит. А кто невзначай уснёт – тот ни с чем и уйдёт.

Как-то по весне жила на крыше одного дома сосулька, которая очень хотела иметь косынку.

И вот однажды утром мимо пробегала маленькая девочка. Малышка очень спешила в детский сад и не заметила, как косынка с ее плеч упала прямо на асфальт. Сосулька по молодости и неопытности подумала, что косынка оставлена в подарок для нее. Все утро она думала, как же добраться до косынки. Наступил день, солнышко засветило ярко и сильно. Сосулька, увлеченная своими мыслями, потихоньку таяла и по капельке капала вниз, прямо на косынку… Она и не заметила, как растаяла вся… Влажная от воды косынка к вечеру высохла под солнечными лучами. А вечером девочка, возвращаясь домой из садика, нашла ее на том самом месте, где оставила утром. Вот и сказочке конец, а кто слушал молодец!

2 уровень.

Карточки с разрезанным текстом.

Задание: Прочитайте сказку, собрав правильно её части.

В то давнее время, когда мир божий наполнен был лешими, ведьмами да русалками, когда реки текли молочные, берега были кисельные, а по полям летали жареные куропатки, в то время жил-был царь по имени Горох…

В старые-стародавние времена царь Горох воевал с грибами.

Гриб боровик, над грибами полковник, под дубочком сидючи, на все грибы глядючи, стал приказывать:

– Приходите вы, белянки, ко мне на войну!

Отказалися белянки:

– Мы – столбовые дворянки! Не пойдем на войну!

– Приходите вы, рыжики, ко мне на войну! Отказались рыжики:

– Мы – богаты мужики! Не пойдем на войну!

– Приходите вы, волнушки, ко мне на войну! Отказалися волнушки.

– Мы, волнушки, – старушки! Не пойдем на войну!

– Приходите вы, опенки, ко мне на войну! Отказалися опенки:

– У нас ноги очень тонки! Не пойдем на войну!

– Приходите, грузди, ко мне на войну!

– Мы, грузди, – ребятушки дружны! Пойдем на войну!

Так и победили грибы царя Гороха!

И я там был. За победу мёд-пиво пил. По усам текло, а в рот не попало.

3 уровень (талантливые и одарённые)

Задание: Устно составьте сказку, используя все композиционные части.

7.Представление выполненной работы спикерами групп.

III .Рефлексия.

1.Проверка усвоения темы.

Перед вами тест. Вспомните то, о чём вы сегодня узнали и ответьте на вопросы.

Мини-тест.

1.Присказка

а) идея сказки, её герои

б) заманилка к слушанию

в) добро побеждает зло.

2.Зачин

а) идея сказки, её герои

б) заманилка к слушанию

в) добро побеждает зло.

3.Концовка

а) идея сказки, её герои

б) заманилка к слушанию

в) добро побеждает зло.

2.Проверка.

Посмотрите на доску и проверьте свою работу (ключ на интерактивной доске)

Поставьте оценку в свой тест.

Если:

все ответы верны – смайлик «улыбается»

один, два ответа не верны – смайлик «грустный»

3.Итог урока – приём «Незаконченные предложения»

По кругу высказываются одним предложением, выбирая начало фразы из рефлексивного экрана на доске.

Сегодня я узнал…..

Было интересно…..

Было трудно….

Я выполнял задания…..

Я понял, что…..

Теперь я могу….

Я почувствовал, что….

Я приобрёл….

Я научился….

У меня получилось…

4.Домашнее задание.

Повторить правило на странице 39-40.

Сочинить присказку, зачин или концовку – по желанию на выбор.

Кто-нибудь обязательно еще вспомнит: «В некотором царстве, в некотором государстве…» или «В тридесятом царстве, в тридесятом государстве…» – и тоже будет прав.

Некоторые сказки начинаются с обычного слова «однажды». А в иных, как, например, в сказке «Три царства – медное, серебряное и золотое» время описывается как будто конкретнее, но все же очень расплывчато, по-сказочному: «В то давнее время, когда мир божий наполнен был лешими, ведьмами да русалками, когда реки текли молочные, берега были кисельные, а по полям летали жареные куропатки…»

Русские народные бытовые сказки, больше похожие на анекдоты, обходятся без традиционных зачинов. Например, «У одного мужика была жена сварливая…» или «В одном селе жили два брата».

Подобные зачины можно встретить не только в русских народных сказках , но и в сказках других народов.

О чем же говорят все эти присказки? Все очень просто. Слушатель или читатель сразу вводится в действие, узнает, с кем, где и в какое время будут происходить сказочные события. И ждет продолжения. Важно и то, что эти фразы ритмично построены таким образом, чтобы создать определенную напевность.

Зачины авторских сказок

У А.С. Пушкина в «Сказке о золотом петушке» собраны воедино сразу два сказочных зачина:

«Негде, в тридевятом царстве,

В тридесятом государстве,

Жил-был славный царь Дадон».

Многие сказки начинаются отнюдь не с традиционных фраз. Например, первая строчка в сказке Андерсена «Огниво» такая: «Шел солдат по дороге: раз-два! раз-два!»

Или вот для примера зачины сказочных повестей Астрид Линдгрен: «В городе Стокгольме, на самой обыкновенной улице, в самом обыкновенном доме живёт самая обыкновенная шведская семья по фамилии Свантесон». («Малыш и Карлсон») «В ту ночь, когда Рони должна была появиться на свет, грохотал гром». («Рони – дочь разбойника»)

Начало, начин, почин; введение, вступление, запев, присказка, приступ. Ant. конец, окончание Словарь русских синонимов. зачин см. начало Словарь синонимов русского языка. Практический справочник. М.: Русский язык. З. Е. Александрова … Словарь синонимов

Вступление к былине при помощи какой либо традиционной формулы, отчасти связанной с повествованием (в отличие от прибаутки или запева, этой связи не имеющих) хронологически, географически и т. п., напр.: «Как во славном во городе во Киеве, У… … Литературная энциклопедия

ЗАЧИН, а, муж. 1. То же, что почин (во 2 знач.) (прост.). 2. В народной словесности: традиционное начало. Былинный з. З. сказки. | прил. зачинный, ая, ое. Толковый словарь Ожегова. С.И. Ожегов, Н.Ю. Шведова. 1949 1992 … Толковый словарь Ожегова

зачин – устойчивая формула, с которой начинаются фольклорные произведения. В сказке зачину может предшествовать присказка, в былине запев. Рубрика: Композиция и сюжет Целое: композиция Прочие ассоциативные связи: жанры фольклора … Терминологический словарь-тезаурус по литературоведению

А; м. 1. Устар. Начало, почин. * Зачин дело красит (Посл.). 2. Лит. Традиционное начало, характерное для произведений фольклора (былины, песни, сказки) … Энциклопедический словарь

зачин – а; м. 1) устар. Начало, почин. * Зачин дело красит (посл.) 2) лит. Традиционное начало, характерное для произведений фольклора (былины, песни, сказки) … Словарь многих выражений

зачин – 1 іменник чоловічого роду вступ; початок зачин 2 іменник чоловічого роду у зачині під замком … Орфографічний словник української мови

зачин – ЗАЧИН, а, м Часть литературного произведения (обычно былины, песни, сказки), характеризующаяся особым складом, приемом, часто определенная фраза, начинающая повествование. Все русские сказки имеют общий зачин … Толковый словарь русских существительных

М. 1. Традиционное начало сказки, былины, песни. 2. разг. Начало, почин. Толковый словарь Ефремовой. Т. Ф. Ефремова. 2000 … Современный толковый словарь русского языка Ефремовой

Зачин, зачины, зачина, зачинов, зачину, зачинам, зачин, зачины, зачином, зачинами, зачине, зачинах (Источник: «Полная акцентуированная парадигма по А. А. Зализняку») … Формы слов

Книги

- Большой зачин , Коптелов А.. Роман А. Л. Коптелова посвящен жизни и революционной деятельности молодого Ильича. Действие романа охватывает период, когда Владимир Ульянов приехал в Питер с берегов родной Волги, стал…

- Большой зачин , Афанасий Коптелов. В романе Афанасия Коптелова “Большой зачин” читатель встречается в В. И. Лениным и его соратниками…

ЗАЧИН – это… Что такое ЗАЧИН?

зачин — начало, начин, почин; введение, вступление, запев, присказка, приступ. Ant. конец, окончание Словарь русских синонимов. зачин см. начало Словарь синонимов русского языка. Практический справочник. М.: Русский язык. З. Е. Александрова … Словарь синонимов

Зачин — вступление к былине при помощи какой либо традиционной формулы, отчасти связанной с повествованием (в отличие от прибаутки или запева, этой связи не имеющих) хронологически, географически и т. п., напр.: «Как во славном во городе во Киеве, У… … Литературная энциклопедия

ЗАЧИН — ЗАЧИН, а, муж. 1. То же, что почин (во 2 знач.) (прост.). 2. В народной словесности: традиционное начало. Былинный з. З. сказки. | прил. зачинный, ая, ое. Толковый словарь Ожегова. С.И. Ожегов, Н.Ю. Шведова. 1949 1992 … Толковый словарь Ожегова

зачин — устойчивая формула, с которой начинаются фольклорные произведения. В сказке зачину может предшествовать присказка, в былине запев. Рубрика: Композиция и сюжет Целое: композиция Прочие ассоциативные связи: жанры фольклора … Терминологический словарь-тезаурус по литературоведению

зачин — а; м. 1. Устар. Начало, почин. * Зачин дело красит (Посл.). 2. Лит. Традиционное начало, характерное для произведений фольклора (былины, песни, сказки) … Энциклопедический словарь

зачин — а; м. 1) устар. Начало, почин. * Зачин дело красит (посл.) 2) лит. Традиционное начало, характерное для произведений фольклора (былины, песни, сказки) … Словарь многих выражений

зачин — 1 іменник чоловічого роду вступ; початок зачин 2 іменник чоловічого роду у зачині під замком … Орфографічний словник української мови

зачин — ЗАЧИН, а, м Часть литературного произведения (обычно былины, песни, сказки), характеризующаяся особым складом, приемом, часто определенная фраза, начинающая повествование. Все русские сказки имеют общий зачин … Толковый словарь русских существительных

Зачин — м. 1. Традиционное начало сказки, былины, песни. 2. разг. Начало, почин. Толковый словарь Ефремовой. Т. Ф. Ефремова. 2000 … Современный толковый словарь русского языка Ефремовой

зачин — зачин, зачины, зачина, зачинов, зачину, зачинам, зачин, зачины, зачином, зачинами, зачине, зачинах (Источник: «Полная акцентуированная парадигма по А. А. Зализняку») … Формы слов

|

Русские народные сказки – основополагающий элемент народного творчества наших предков. В этих повествованиях мы сталкиваемся с незабываемыми приключениями героев, с описаниями их повседневной жизни, в том числе быта и работы, с фантастическими существами и с мистическими явлениями. Детские – это наши первые встречи с добром и злом, с радостью и грустью, со смехом и задором и даже со страхом. Мы знакомы с самого детства с их героями и любовь к ним не проходит на протяжении всей нашей жизни, уже во взрослой жизни продолжая умилять и удивлять. Не раз мы сталкиваемся с тем, что прочитав ребенку русскую народную сказку, мы и для себя всегда находим там что-то новое и поучительное. Во все времена сказки вдохновляли творческих людей на постановки детских спектаклей, написание картин, создание истинных шедевров кинематографии. Композиция сказки: Обычно русские народные сказки для детей имеют четкую композицию. Стандартная композиция сказки включает в себя зачин, то есть то, какое начало у сказки. Это может быть и “В некотором царстве, в некотором государстве…” и “Жили-были…” и другие варианты, которые уже с первых слов настраивают нас на сказочный лад. Далее идет основная часть сказки, в которой происходят все события сказочного сюжета, ну и заканчивается сказка обычно тоже по-особенному. Вариантов окончания сказки огромное множество, самые знакомые из них – это:

Особенности русских народных сказок: Вспомните только фразы, которые мы даже потом сами невольно используем в своей жизни: идти куда глаза глядят; скоро сказка сказывается, да не скоро дело делается… А какую поэтичность сказкам придает простое перемещение прилагательного после сказуемого, как песня тогда читается сказка, на одном дыхании: солнышко красное, красавица писаная… Особенности русских народных сказок, конечно же, также в их написании, в сокращении слов. Мы ведь начиная читать сказку, сразу понимаем, что эта сказка русская. По одним только словам. Что невесел, буйну голову повесил? А детские с их ласковыми именами? Это и петушок и солнышко и братец и сестричка и многие другие. За счет такого написания, эти сказки так любимы нашими малышами, когда мама их читает, такие ласковые и добрые. Вот говорят, что сейчас век высоких технологий и новых прогрессивных средств массовой информации, но можете ли вы представить себе, что не прочитаете ни одной сказки своему ребенку? Это кажется невозможным, даже немножечко глупым и смешным. Сказки настолько давно и настолько прочно вошли в нашу жизнь, что нам остается радоваться их огромному количеству и выбирать свои любимые для чтения их детям. Сценарий развлечения по сказкам для старших дошкольников и младших школьников Досуг для детей 5-9 лет: «В мире сказок». Дворецкая Татьяна НиколаевнаГБОУ СОШ №1499 СП №2 дошкольное отделение Воспитатель Описание: Досуг познакомит детей старшего дошкольного и младшего школьного возраста с разными видами сказок. Назначение работы:

Досуг предназначен для детей старшего дошкольного и младшего школьного возраста, воспитателей дошкольных учреждений и родителей. Вступительная часть в стихах. Сказка устный пересказ И герои и злодеи Ценность сказки велика! Кто с достоинством пройдет Сказка – наш бесценный дар! Справедливость торжествует Входит в каждый дом! Сказка древняя затея Досуг: В мире сказок. Ведущая: Большое значение в жизни детей имеет сказка. Сказки к нам пришли из глубины веков. Сказки слагал народ, запоминал и рассказывал друг другу. Ходили сказки по миру от одних слушателей к другим. Каждый рассказчик добавлял в сюжет сказки небольшие изменения и дополнения. Потом сказки стали собирать и записывать. Так сказки дошли до наших дней. Сюжеты сказок такие разные: веселые и грустные, страшные и смешные. Из сказок мы узнаем о культурных традициях, о народном жизненном укладе, о характерах людей живших много лет тому назад. Сказки знакомы и любимы всем людям с детства.Что же такое сказка? Народная сказка – устный рассказ художественного произведения с установкой на вымысел, рассказываемый слушателям в воспитательных или развлекательных целях. Послушайте народные пословицы о сказках: Кашу кушай, а сказку слушай: умом – разумом смекай, да на ус мотай. Сказка от начала начинается, до конца читается, в середке не перебивается. Скоро сказка сказывается, да не скоро дело делается. В каждой сказка будет конец. Сказка вся, больше сказывать нельзя. Сказку слагать дело не простое. Каждая сказка имеет план построение сюжета: 1. Присказка – эстетический элемент в сказке. Является необязательным условием в построении сюжета сказки. Цель присказки – подготовить слушателей к восприятию сказки, настроить их. Присказка существует сама по себе, она не связана с содержанием произведения. Наличие присказки зависит от таланта сказочника, его характера. Пример: «Ай, потешить Вас сказочкой? А сказочка чудесная, есть в ней дива дивные, чуда чудные!» 2. Зачин – начало сказочного действия. Зачин уводит слушателя в сказочный мир, подчеркивает необычность того сказочного мира о котором дальше пойдет рассказ. Пример: «В некотором царстве, в некотором государстве жил-был Иван-Царевич» Зачин в сказке имеет огромную роль, он определяет место действия и время, знакомит с главными героями сказки. С помощью зачина автор увлекает читателя или слушателя в сказочный мир и завораживает его загадочностью и неопределенностью. 3. Основная часть сказки – это центральное действие сказки и развязка. Именно в этой части происходят волшебные превращения, произносятся магические слова, встречаются предметы или животные помощники, обладающие волшебным даром и т.д. Пример: «Сивка-бурка, вещая каурка! Стань передо мной, как лист перед травой!» 4. Исход или концовка – заключительная часть сказки. В ней подводятся итоги сказочного действия. Пример: «Стали они жить поживать и добра наживать». Известный собиратель сказок Александр Николаевич Афанасьев собрал великое множество народных сказок и разделил их по сюжету на: волшебные, бытовые, авантюрные, докучные, сказки о животных. Давайте познакомимся с удивительным и разнообразным миром сказок. 1. Сказки о животных. Сказки о животных являются самыми древними произведениями. Древний человек одушевлял природу, наделял животных свойствами и качествами присущими человеку. 2. Докучные сказки. Докучные сказки – это сказки с бесконечно повторяющимся содержанием. От слова «докучать» – надоедать. С их помощью сказочник то разжигал интерес к слушанию сказок, то наоборот, останавливал тех, кто готов слушать их бесконечно. Ребята, а кто из Вас уже знаком с такими сказками? 3. Сказки бытовые Бытовая сказка – это необыкновенные, неслыханные истории, истории о невозможном. Героями бытовых сказок являются бояре, чиновники, судьи наделенные всяческими пороками: глупостью, жадностью, безответственностью. 4. Сказки авантюрные Сказки авантюрные – краткий занимательный рассказ, сюжет из реальной жизни, который высмеивает общечеловеческие пороки. Это сказки о болтливых и жадных женах, о ленивых и неряшливых хозяйках, о наивности и человеческой простоте. Ребята, вспомните и назовите такие сказки? (ответы детей) 5. Волшебные сказки Волшебная сказка – самая яркая и распространенная в мире. Сказка наполнена чудесами и приключениями. Викторина: Угадайте сказку 1. В какой сказке на море океане жил чудо юдо рыба кит? (Конек – Горбунок) 2. В какой сказке вырос овощ, который не могли вытащить из земли три человека и 3 животных? (Репка) 3. В какой сказке простой деревенский мужик во дворец на печи отправился? (По щучьему велению) 4. В какой сказке злая мачеха отправила девушку в лес за подснежниками? (Двенадцать месяцев) 5. В какой сказке старуху за жадность наказали? (Золотая рыбка) 6. В какой сказке девочка медведя перехитрила? (Маша и медведь) 7. В какой сказке отец в наследство сыну оставил кота? (Кот в сапогах) 8. В какой сказке девочка помогла выздороветь больной ласточке? (Дюймовочка) 9. В какой сказке все звери поселились в одном доме? (Теремок) 10. В какой сказке волк голос у кузнеца перековал? (Волк и семеро козлят) 11. В какой сказке девочку и ее собаку ураган унес в сказочную страну, где она нашла друзей? (Волшебник Изумрудного города) 12. В какой сказке был Цветочный город, в котором жили коротышки? (Приключения Незнайки и его друзей) 13. В какой сказке тыква превратилась в карету? (Золушка) 14. В какой сказке главный герой шалунишка, который живет на крыше? (Карлсон, который живет на крыше) 15. В какой сказке жили сестрицы одноглазка, двуглазка и триглазка? (Крошечка-Хаврочечка) Ведущая: Молодцы ребята, сказки внимательно слушали, всех сказочных героев знаете, и названия сказок Вы назвали абсолютно верно! А сами сказки сочинять умеете? (ответы детей) А это мы сейчас и проверим. Я начинаю, а Вы по очереди продолжаете. Итак, в некотором царстве, в некотором государстве жил был царь Еремей. Было у него три сына. Один был высокий, другой был роста среднего, а младший был низкий, росточком с табурет. И вот собрал сыновей отец и говорит: …(Дальше сюжет сказки складывают все дети группы по очереди). Неотъемлемая часть любой сказки — это наличие в ней таких структурных компонентов как зачин, присказка или запев, и концовка. Каждая из этих частей играет свою определенную и очень важную роль в системе всего жанра. Все это – особая формула стиля, которая обусловливает непреходящий интерес к сказке, с ее богатым идейным содержанием, ясностью и чистотой выражаемых мыслей, художественной отточенностью и занимательностью сюжета. ПрисказкаОбычно сказки, и в особенности волшебные, открывают свое повествование с присказки. Основная задача такого начала — погрузить читателя в особую атмосферу фантастического мира и настроить его, читателя или слушателя, на нужное восприятие сказочных событий всего произведения. С первых строк магическое пространство будто бы обволакивает нас благодаря присказке, несмотря на то, что она имеет сравнительно небольшой размер. Стоит только вспомнить всем известного кота-Баюна, который мерно ходит и распевает свои песни по мощному дубу, возвышающемуся на острове посреди «океяна». Удивительно, что особый настрой, призванный помочь постичь всю глубину и мудрость народной мысли рождается не от напыщенной назидательности, но с помощью юмора, который и свойственен присказке. Прием игры слов, элементы некоторой путаницы помогают избавить сказку от лишнего нравоучительного тона, но сохранить свое воспитательное назначение. ЗачинСледующий неотъемлемый компонент любой сказки – зачин. Его цель состоит в выполнении нескольких важных задач, и, прежде всего, это обеспечение читателя достаточной информацией для того, чтобы помочь ему сформировать правильное представление о героях сказки, а в дальнейшем ходе повествования правильно понять и оценить их характеры, образ мыслей, причинно-следственные связи их поведения и поступков. Таким образом, зачин, знакомит нас со сказочными персонажами, отправляет в нужное время и место описываемых событий. Уже из зачина становится очевидным, что язык сказки совершенно особенный, не похожий на речь, привычную нашему слуху – стоит вспомнить традиционное «жили-были» или «сказка сказывается». КонцовкаНо любое сказочное действие неизбежно должно быть приведено к своему логическому завершению, и здесь наступает время концовки со своей целью закончить рассказанную историю. Обычно с этой задачей справляются уже всем знакомые и вполне устойчивые высказывания: «живут-поживают, да добра наживают» или «по усам текло, в рот не попало». Но не всегда концовка – это некоторое очевидное умозаключение, автор вполне себе может закончить свой сказ неожиданно и внезапно. Но он не должен забывать, что концовка, тем не менее, обязана быть составлена грамотно, так, чтобы безусловно в ней содержались выводы о рассказанном. Для жанра сказки, также, характерно обильное употребление повторов, истинное назначение которых — приближать действие произведения к своему завершению, развязке. Повторы, каждый раз указывая на определенные детали предмета, персонажа или явления, служат целью усилить оказываемое впечатление на читателя. Особую роль здесь играют детали, повторенные троекратно: три сына, три головы змея Горыныча, три испытания, данные герою. Стихотворные части сказокВо многих сказках обнаруживаются и части стихотворные, с особой рифмовкой. Таким образом создается своя собственная мелодия сказки, мотив, ее напевность и музыкальное настроение, в целом. «Сказовый» стих обычно может включать в себя разное количество слогов, но вот ударения, преимущественно, по количеству равные. Отсюда вытекает еще одна особенность сказочного повествования – нередко можно встретить сказку, сродни песне. Часто прекрасные девицы запевают на берегу чистого озера свои печальные думы, или голосистый петушок песней призывает на помощь, попав в хитрые лапы проворной лисицы. Из последнего примера, также, можно сделать вывод о том, что в сказках, также, широко распространено звукоподражание. Диалогам в сказочном произведении всегда присущи живость и естественность. Интонацией персонажи нередко выдают свои истинные намерения и не всегда присущие им положительные качества – например, речь лисицы обязательно будет преисполнена лести, а голос солдата останется бойким, ровным и стройным в любой ситуации. Насыщенность сказки различного рода повторами, параллелизмом, ритмическими конструкциями и другими своеобразными средствами выразительной речи, несомненно, доказывают красочность и богатство живого народного языка. Сохраняя и передавая из поколения в поколение высокие понятия о содержании добра и зла, справедливости, истине и других моральных ценностей сказка является источником всех самых важных жизненных определений и закономерностей. О структуре сказок рассказывала Короткова Юлия Вопрос «С каких слов начинаются ?», он, скорее всего, назовет фразу «Жили-были…». Действительно, это наиболее частый зачин русских народных . Кто-нибудь обязательно еще вспомнит: «В некотором царстве, в некотором государстве…» или «В тридесятом царстве, в тридесятом государстве…» – и тоже будет прав. Некоторые сказки начинаются с обычного слова «однажды». А в иных, как, например, в «Три царства – медное, серебряное и золотое» время описывается как будто конкретнее, но все же очень расплывчато, по-сказочному: «В то давнее время, когда мир наполнен был лешими, ведьмами да русалками, когда реки текли молочные, берега были кисельные, а по полям летали жареные куропатки…» Русские народные бытовые сказки, больше похожие на анекдоты, обходятся без традиционных зачинов. Например, «У одного мужика была жена сварливая…» или «В одном селе жили два брата». Подобные зачины можно встретить не только в русских народных сказках, но и в сказках других народов. О чем же говорят все эти присказки? Все очень просто. Слушатель или читатель сразу вводится в действие, узнает, с кем, где и в какое время будут происходить сказочные события. И ждет продолжения. Важно и то, что эти фразы ритмично построены таким образом, чтобы создать определенную напевность. Зачины авторских сказокУ А.С. Пушкина в «Сказке о золотом петушке» собраны воедино сразу два сказочных зачина: Многие сказки начинаются отнюдь не с традиционных фраз. Например, первая строчка в сказке Андерсена «Огниво» такая: «Шел солдат по дороге: раз-два! раз-два!» Или вот для примера зачины сказочных повестей Астрид Линдгрен: «В городе Стокгольме, на самой обыкновенной улице, в самом обыкновенном доме живёт самая обыкновенная шведская семья по фамилии Свантесон». («Малыш и Карлсон») «В ту ночь, когда Рони должна была появиться на свет, грохотал гром». («Рони – дочь разбойника») Но и здесь можно проследить, что сказки начинаются либо с представления героя, либо с обозначения места действия, либо говорят о времени. Очень редко можно встретить сказки, начало которых посвящено пространным описаниям. Обычно зачины достаточно динамичны. Например, один из любимейших российских детских поэтов Корней Иванович Чуковский без предисловий, сразу, будто на бегу вводит читателя в гущу сказочных событий. «Одеяло убежало, улетела простыня, и подушка, как лягушка, ускакала от меня». («Мойдодыр») «Скачет сито по полям, а корыто по лугам». («Федорино горе») Хороший зачин в сказке важен. От него зависит настрой, с которым слушатель или читатель погрузится в повествование. |

Сочинить волшебную сказку присказка зачин концовка. “Композиционные части сказки: присказка, зачин, концовка”

Подготовьте сказывание отрывка из сказки, используя особенности одного из сказителей (на выбор). Используйте зачины, присказки, концовки, повторы.

Ответ

Используем для сказывания отрывок из красивой сказки Анны Барышниковой «Как барин собакой брехал».

Жил да был злой барин в деревне, и наказал он одного мужика через суд тем, что должен был тот брехать у него собакой, вместо убитой.

Брешет мужик год, брешет второй, надоело ему брехать и решил подговорить друзей обокрасть барина.

Те воруют, мужик брешет, барин его хвалит. У на утро хвать — обокрали, снова потащил барин мужика в суд. А судья в отказ — мужик свое дело исполнял, брехал и брехал.

Повез барин мужика в столицу, а ехали лесом. Ну мужик и напугал барина медведем, да сказал, что те собачьего лая бояться.

Стал тут барин брехать как собака, аж глаза на выкате. А медведя не было, сосна только стояла.

Стал барин просить, чтобы мужик никому не рассказывал как он опозорился, а мужик не согласен.

Барин с позору удавился, а мужик вольным стал и живет добро наживает.

Зачин сказки, присказка, былинный запев, молитвенное вступление, концовка – это части, входящие в структуру фольклорного произведения. Их следует отличать друг от друга. Сложное композиционное построение народных сказок не является случайным. Каждая из имеющихся в них частей играет определенную роль.

Что такое присказка

Большинство сказок, особенно волшебных, начинаются с присказки. Благодаря ее существованию слушатель постепенно погружается в особый мир и тем самым готовится к восприятию всего

Читая или слушая присказку, как ребенок, так и взрослый человек в своем воображении создают образ кота Баюна, им видится остров посреди океана, на нем возвышается могучий дуб с золотыми цепями и загадочным сундуком на могучих ветвях, вдали виднеется город из неведомого царства-государства.

Особенность, которой отличается присказка: зачин сказки, несмотря на свои маленькие размеры (порой это лишь несколько слов), способен сразу погрузить читателя в мир магии и волшебства. А это очень важно, ведь человек настроен не только получить наслаждение от прочитанного, но и постичь глубокую народную мудрость, которая заключена в содержании сказки. А без особого настроя добиться этого бывает очень сложно.

Очень часто присказка имеет юмористический характер с элементами неразберихи, тарабарщины, путаницы, игры слов. Благодаря такому приему удается избежать излишней назидательности, но при этом сохранить воспитательную роль произведения.

Функции зачина

Чтобы до конца понять, в сказке, необходимо разобраться в его назначении. Оно состоит в выполнении сразу нескольких задач:

- познакомить читателя с главными произведения;

- рассказать о времени совершения описанного действия;

- дать представление о месте, где происходят события.

Юные читатели должны понимать, что зачин сказки очень важен. Уже в самом начале произведения можно получить достаточно много информации, которая в дальнейшем поможет до конца понять образ героев, их характеры и поступки.

Зачин сказки обязательно укажет на то, что язык произведения, с которым предстоит познакомиться, совершенно не похож на обыденную речь. Примером этому могут стать следующие выражения: “в некотором царстве, в некотором государстве”, “золотые маковки”, “стоит древо”, “сказка сказывается”, “море-окиян” и многие другие “сказочные” слова.

Начало сказок, их разнообразие

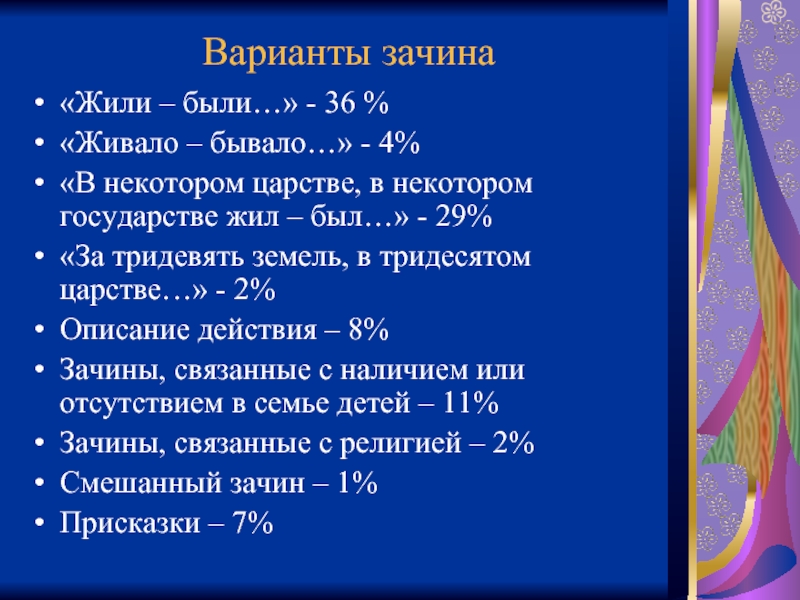

Зачины сказок и концовки имеют огромное разнообразие, их отличает структура, язык, смысловое содержание. Традиционное начало имеют только около 36% фольклорных произведений. Оно известно каждому человеку, воспитанному на традициях С раннего детства, когда ребенку рассказывают сказку, он слышит такие слова: “Жили-были…” Всего же при изложении сказок используется по меньшей мере девять разновидностей зачинов.

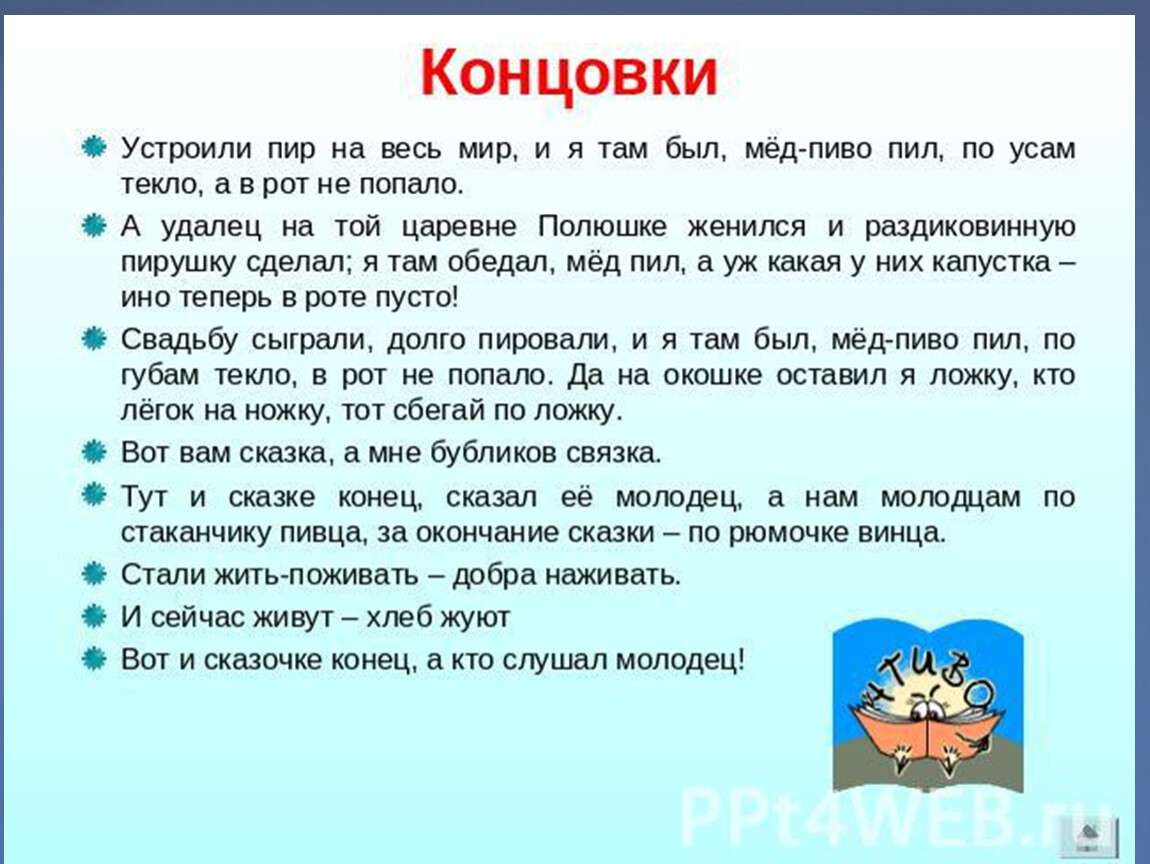

Концовка

“Вот и сказке конец, а кто слушал – молодец!” – традиционная форма концовки многих народных сказок. Кроме приведенного примера известно еще не менее пяти вариантов, с помощью которых сказочник может закончить рассказанную им историю. Зная, что такое зачин в сказке и для чего он используется, нетрудно догадаться, с какой целью употребляется концовка. Сказочные действия должны быть приведены к логическому завершению. Это помогает сделать грамотно составленная концовка произведения. Например, сказочник может закончить повествование так: “Живут-поживают да добра наживают!”, “Так часто бывает!”, “Живут, хлеб жуют!”. Иногда рассказчик может закончить сказку совсем неожиданно, но он должен помнить, что концовка подводит итог всему сказанному.

Другие особенности структуры фольклорного произведения

Сказки, основная ее часть, концовка могут содержать повторы. Каждый новый повтор чем-то отличается от предыдущего, и благодаря этому читатель может предполагать, чем закончится все повествование.

В структуру народных сказок естественным образом вписываются стихотворные части, что придает произведению музыкальность, настраивает читателя на особую поэтическую волну.

Стихи, используемые сказочником, имеют свои особенности. Огромный интерес у читателей вызывают сказочные повествования, полностью написанные таким стихом. Литераторы называют его сказовым.

В процессе изложения содержания сказки рассказчику иногда приходится не только говорить, но даже петь, так как герои часто используют именно такую между собой. Достаточно вспомнить сказки “Сестрица Аленушка и братец Иванушка”, “Кот, Петух и Лиса”, “Волк и семеро Козлят” и другие.

Звукоподражания, живой диалог между эпитеты, сравнения, гиперболы делают произведения народного творчества яркими и неподражаемыми. Ведь не зря русские сказки любят все, от мала до велика: в фольклоре заключена не только мудрость, но и истинная красота русского слова.

«В гостях у сказки» – Могу всё. “Спасите, нас съел серый волк” “ Очень расстроена. “Телеграмма”. Унесли братишку птицы. Отворили дверь козлята И пропали все куда-то. Женюсь на лягушке”. Заигралась сестрица. Сказки о животных, бытовые сказки. Сказочные заклинания. «По щучьему веленью, По моему хотенью». Описательного типа.

«Секреты сказок» – Лес. Ребята. Сочинители сказок. Формирование способности к восприятию нового знания. Мастера-сказочники. Секреты сказки. Корабльhttp. Виды сказок. Волшебная сказка. Творческая работа. Сказки-воспитатели.

«Сказки для 5 класса» – Моя любимая русская народная сказка. Элементы сказок. Примеры. Иван Андреевич Крылов. Самые известные басни. Виды сказок. Род литературы. Иван – крестьянский сын и чудо – юдо. Михайло Васильевич Ломоносов. Сказка.

«Волшебный мир сказок» – Загадочный мир сказок. Долго она бегала по полям, по лесам. Посели сказку в нужное жилище. Узнай сказку. Собери отрывок из сказки. Какие бывают сказки. Инсценировка сказок. В какое творчество входят сказки. Не поверили Иванушке братья, посмеялись над ним вволю. Солдат топор вымыл, опустил в котел, налил воды и поставил на огонь.

«Сказка как вид народной прозы» – Сказка. Теплота. Эпиграф. Занимательный рассказ. Полное сердце любви. Сказка как вид народной прозы. Экспертиза. Каша из топора. Интерес. Сценическое искусство.

«Волшебные сказки» – Гипербола – Котору лошадь по крестцу ударит, так и с ног долой упадёт. Волк побежал стрелой. Герои уходят из дома, чтобы всё исправить. «Сказка – складка (вымысел), а песня – быль…От слова «складывать». В тридесятом царстве, небывалом государстве… Сюжет волшебных сказок. Постель -пуховая. А вниз идёт – сказки сказывает.

Реальными создателями сказок были, конечно же, их исполнители – многие и многие безымянные сказочники. Вспомним, что народная сказка в отличие от литературной всегда рассказывалась, а не читалась…

Талантливые сказочники – это прежде всего знатоки сказок: от каждого из них собиратели, как правило, записывали большое количество сказок – иногда более ста! Сказочники в то же время и настоящие актёры.

Неспешно ведёт сказочник повествование о волшебных приключениях Ивана-царевича и серого волка; жесты скупы, голос ровный, речь течет неторопливо – кажется, ничто не волнует его, а мы взволнованны. Но вот сказочник начал сказку о животных, и манера исполнения изменилась. Голос его как бы исчез, но вместо его голоса появилось несколько новых и очень запоминающихся: «толстый» – это говорит медведь, хозяин лесов; слащавый, с хитринкой – это лиса, Лиса Патрикеевна, лисица – масляна погубица, кумушка лиса. Тоненьким голосочком ведёт разговоры зайчик – заюшка-побегаюшка.

Много талантливых сказочников! К сожалению, не обо всех мы располагаем данными, раскрывающими их творческий облик и жизненный путь. Однако о некоторых у нас есть сведения, хотя порой и скудные. Искусной сказочницей была няня А. С. Пушкина Арина Родионовна: её исполнение очаровывало великого поэта. С теплотой вспоминал свою няню Евгению М. Горький.

Сказочники были окружены вниманием, уважением, любовью. Часто их освобождали от тяжёлой физической работы, только бы они рассказывали. Известный сибирский сказочник И. Е. Сороковиков-Магай в 1930-е годы вспоминал: «Приезжаешь на мельницу – даже принимают мешки мне-ка помогать. „Он сёдне будет рассказывать сказки!” И пускали через очередь: „Смелем тебе, только говори сказки нам!” Но и на промыслу (на охоте) с товарищами приходилось говорить много. Ночь длинная, осеновская. Делать нечего. Начинаешь сказки говорить, и у них настроение повышается».

По Ю. Г. Круглову

Известный учёный, исследователь русского фольклора Марк Константинович Азадовский оставил интересные характеристики наиболее талантливых сказочников.

Замечательный сказочник Д. С. Асламов каждый раз готовился к сеансу, повторяя про себя сказки, и потом тщательно заботился, чтобы «всё было на месте и к месту».

Енисейский сказочник Ф. И. Зыков утверждает, что самое трудное в сказке – «разговор» (то есть диалог). «Тут одно слово неладно – и ничего не получится. Тут надо всё быстро делать».

А. К. Новопольцев вносит в волшебную сказку разнообразные «потешные элементы», рифмовку.

Форма особого балагурного стиля представлена и сказительницей А. К. Барышниковой. Она использует в сказках зачины, концовки, повторы, подробности, вводит ритм, рифму. Каждый раз она творит сказку.

Н. О. Винокурова сопровождает свои сказывания сказок жестами, мимикой героев, вводит в текст песни, пейзаж.

Известны и другие сказочники. Прочитайте книгу «Фольклор и литература» (М., 1996). Подготовьте к сказыванию для вечера сказок любимую сказку, подумайте, какие «краски» будете использовать при этом.

Обогащаем свою речь

- Как вы думаете, почему ровная, неторопливая, даже немного торжественная манера оказывания волшебных сказок не годится для исполнения сказок о животных?

- Каковы особенности сказывания сказок у разных сказителей?

- Какими приёмами сказителей вы бы воспользовались при подготовке пересказа сказки?

- Подготовьте сказывание отрывка из сказки, используя особенности одного из сказителей (на выбор). Используйте зачины, присказки, концовки, повторы.

- Рассмотрите несколько слов-синонимов. Есть ли среди них сленг, разговорные слова?

- Ругать – бранить – обзывать;

- талантливый – знаток – классный.

Литература и изобразительное искусство

- Каких художников – иллюстраторов народных сказок вы знаете и какие сказки они иллюстрировали?

- Кто из художников украшает иллюстрации орнаментами?

- Рассмотрите иллюстрации И. Билибина, репродукцию картины В. Васнецова. Составьте пересказы эпизодов сказок, опираясь на иллюстрации художников («Пир», «Встреча Ивана-царевича с царевной-лягушкой», «Встреча со старым старичком», «Иван-царевич и щука»).

Проверьте себя

Кто из сказочников пользовался следующими приёмами:

- вносил «потешные элементы», рифмовку;

- вводил в текст песни, пейзаж;

- использовал зачины, концовки, повторы;

- считал, что самое трудное в сказке – «разговор»;

- заботился о том, чтобы «всё было на месте и к месту»?

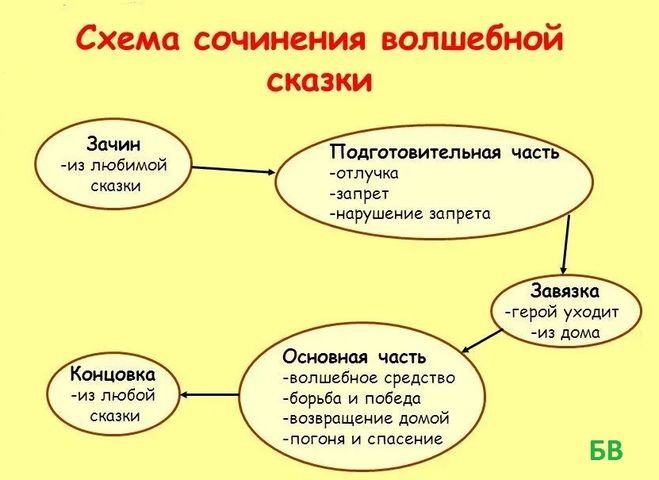

У волшебных сказок строгая и стройная композиция. Она в основном держится на единстве идеи, пронизывающей весь рассказ. При этом сюжет может становиться очень сложным, включать множество побочных ходов, но все действия в сказке основаны на стремлении главного героя к цели. Очень часто, когда герой оказывается близок к цели, повествование вдруг делает поворот к неудаче, начинается новый цикл приключений и поисков. Сказка неизменно разрешается благоприятным исходом для положительного героя.

Лучшие волшебные сказки характеризуются традиционными формулами присказки, зачина, повествования и концовки. Иногда сказка начинается с присказки, которая не связана с фабулой сказки. Цель присказки – показать мастерство сказочника, подготовить аудиторию к слушанию сказки. Присказка – необязательная часть волшебной сказки, она может быть короткой: «Дело было на море, на окияне, на острове Буяне, среди воды, где деревья росли», или развернутой: «Начинается сказка от Сивки, от Бурки, от вещей каурки. На море, на океане, на острове Буяне стоит бычок печеный, возле него лук толченый; шли три молодца, зашли да позавтракали, а дальше идут – похваляются, сами собой забавляются. Это присказка, сказка будет впереди!».

За присказкой следует сказочный зачин, который своей неопределенностью снимает вопрос о достоверности событий. Зачин указывает фантастическое место («В некотором царстве, в некотором государстве»), фантастическое время («При царе Горохе») и называет героев («Жил-был царь и было у него три сына»). После зачина следует основная повествовательная часть сказки. Повествование ведется при помощи многочисленных художественных приемов, один из них – сказочные формулы или общие места: «скоро сказка сказывается, да не скоро дело делается», «утро вечера мудренее», «такая краса, что не в сказке сказать, ни пером описать» и др. Структура сказки подчинена созданию драматически напряженных ситуаций, что подчеркивает повтор событий. Чаще всего событие повторяется три раза – троичность действия, возможно троекратное повторение эпизода с наращением эффекта, этот прием придает сказке характерную эпичность, замедленность в развитии действия. В сказке встречаются и многократные повторы.

Волшебные сказки иногда очень большие по объему, чему способствует использование приема «нагромождение однородных действий». В сказке «Марья Моревна» этот прием используется неоднократно, в ней как бы соединены несколько сюжетов. Идейная направленность сказки обусловила и контрастную обрисовку достоинств героя и пороков его врагов, поэтому контрастность – один из основных художественных приемов в сказке. Психологические характеристики элементарны, одни всегда положительные, другие – отрицательные. Действующих лиц немного, только те, которые принимают активное участие в действии. Характеры героев не изменяются, проявляются не в рассуждениях, а в действии, в поступках. Волшебная сказка не останавливается перед прямой идеализацией героя и героини.

Для сказочного сюжета характерен прием «отраженного действия», основанный на том, что если герой в начале сказки великодушно оказывает кому-то помощь, то впоследствии ему платят добром («Волшебное кольцо», «По щучьему велению»). В волшебных сказках встречается и прием «ступенчатое сужение образа» (например, описание места, где спрятана смерть Кощея – от описания острова, где растет дуб… до кончика иглы). В драматически напряженных местах сказка прибегает к повторности описания, к рифмованному параллелизму («конь бежит, земля дрожит», «пестом погоняет, помелом ему подметает»). В сказке широко используется ретардация, замедление в развитии действия, чему способствует использование повторов, троичность действия, а также драматический и живой диалог, который повторяется без изменений на протяжении повествования.

Сказка обычно заканчивается концовкой, которая, как и присказка, часто шутлива, ритмична, рифмована: «и я там был, мед-вино пил, по губам текло, в рот не попало», «вот сказка, а мне бубликов связка». Назначение концовки – вернуть слушателя из сказочного мира в реальный. Присказки, зачины и концовки имеют довольно устойчивый текст и представляют собой своего рода формулы.

Язык волшебной сказки приближен к разговорной речи, в ней используются, как и во всех фольклорных произведениях, постоянные эпитеты (море синее, лес дремучий), тавтологические сочетания (диво-дивное, чудо-чудное), сросшиеся синонимы (путь-дороженька, грусть-тоска). Текст сказки насыщен пословицами, поговорками, загадками.

Тематические материалы:

Обновлено: 14.07.2019

103583

Если заметили ошибку, выделите фрагмент текста и нажмите Ctrl+Enter

начальных тем | GradeSaver

Начало начинается – и, возможно, заканчивается – внутри сна, и каждая сцена просит зрителя оценить, действительно ли то, что они видят, является сном или нет. В фильме сны представляют собой воображаемые арены, где секреты, травмы и неразрешенные чувства уязвимы для раскрытия и извлечения. Кобб и Артур впервые появляются во сне Сайто, пытаясь извлечь бизнес-секреты для компании под названием Cobol Corporation, а позже должны проникнуть в сны Роберта Фишера.Как Кобб объясняет Ариадне, сны наполнены «проекциями» разума сновидца, и разум Кобба, в частности, преследует чувство вины из-за воспоминаний о его мертвой жене Мэл. Кобб предупреждает Ариадну никогда не строить миры снов, используя воспоминания, которые могут быть слишком соблазнительными и увести мечтателя от реальности.

Кристофер Нолан заявил, что он хотел, чтобы Inception отражал идею о том, что сны кажутся реальными до тех пор, пока они происходят. Реальность, или оболочка реальности, является ключевым аспектом Inception, , который информирует не только о сценах, в которых персонажи населяют внешний мир, но и о тех, где персонажи мечтают.Для того, чтобы сконструированная мечта была эффективной, она должна, по сути, представлять собой реальность, поэтому тонкая ошибка Нэша при воссоздании коврового покрытия Сайто ставит под угрозу миссию во вступительной части фильма. Нолан постоянно стирает грань между реальностью и сновидениями: фильм начинается с мечты во сне, которую зритель может легко принять за реальность, а Мэл убивает себя, потому что думает, что реальность – это еще один сон.

Начало – фильм, который вращается вокруг использования технологий военного уровня в соперничестве между двумя транснациональными корпорациями, возглавляемыми Сайто и Робертом Фишерами.Хотя во внешнем мире это соперничество принимает форму корпоративного шпионажа, в мире сновидений эта враждебность часто перерастает в прямое насилие и войну. Согласно научно-фантастической посылке фильма, в котором технология «обмена сновидениями» сделала мысли уязвимыми для воровства, такие важные цели, как Сайто и Фишер, должны милитаризировать свое подсознание против нежелательных угроз. Нолан использует тему войны, чтобы показать, как разум естественным образом защищает себя от манипуляций и принуждения, например, когда проекции во сне Фишера запускают скоординированную засаду, чтобы отразить попытку проникновения команды Кобба.